实验室与字节跳动、复旦大学、北京大学等联合发布 A Survey on Latent Reasoning

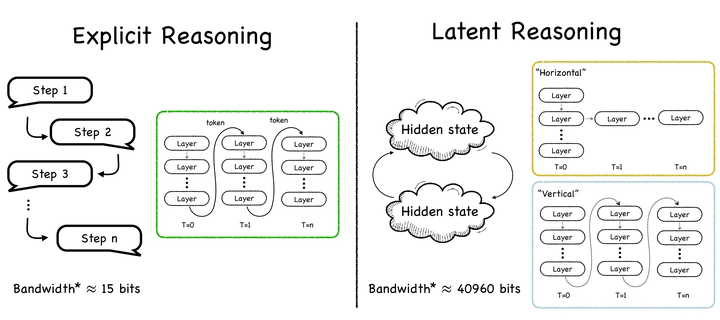

大型语言模型 (LLM) 已经展示了令人印象深刻的推理能力,尤其是在由明确的思维链 (CoT) 推理指导时,该推理将中间步骤用语言化。虽然 CoT 提高了可解释性和准确性,但它对自然语言推理的依赖限制了模型的表达带宽。Latent Reasoning 通过完全在模型的连续隐藏状态下执行多步骤推理来解决这一瓶颈,消除了令牌级监督。为了推进潜在推理研究,本调查全面概述了新兴的潜在推理领域。我们首先研究了神经网络层作为推理计算基础的基础作用,重点介绍了分层表示如何支持复杂的转换。接下来,我们探讨了不同的潜在推理方法,包括 基于激活的递归 、 隐藏状态传播和微调策略,用于压缩或内部化显式推理跟踪。最后,我们讨论了高级范式,例如通过掩蔽扩散模型进行无限深度潜在推理 ,从而实现全局一致和可逆的推理过程。通过统一这些观点,我们的目标是阐明潜在推理的概念景观,并大语言模型认知前沿的研究指明未来的方向。